Dlaczego w IoT samo „wrzucenie wszystkiego do chmury” przestaje wystarczać

Typowa architektura IoT oparta wyłącznie na chmurze

Klasyczny projekt IoT zaczyna się zwykle bardzo prosto. Są czujniki (np. temperatury, wibracji, wilgotności, położenia), które zbierają dane. Te dane trafiają przez sieć (Wi‑Fi, LTE, 5G, LoRaWAN, Ethernet) do chmury. W chmurze działa logika aplikacji: reguły, algorytmy analityczne, system alarmów, panele raportowe. Na końcu użytkownik widzi efekty w aplikacji webowej lub mobilnej.

W takim modelu obowiązuje zasada: „wszystkie dane wysyłamy do chmury, wszystkie decyzje zapadają w chmurze”. Po stronie urządzeń uruchamia się tylko minimalną logikę – odczytaj, spakuj, wyślij. Po stronie serwera dzieje się reszta: walidacja, agregacje, wykrywanie anomalii, szacowanie ryzyka awarii, integracje z systemami biznesowymi.

Dla pilotażowych wdrożeń, projektów PoC (proof of concept) i małych flot urządzeń takie podejście zwykle wystarcza. Mało danych oznacza niskie koszty transferu. Prosta logika upraszcza firmware. Brak przetwarzania lokalnego skraca czas wejścia z produktem na rynek. Problem zaczyna się wtedy, gdy projekt zaczyna rosnąć, a wymagania co do czasu reakcji i niezawodności rosną razem z nim.

Skala, pasmo, koszty i opóźnienia – gdzie chmura zaczyna ciążyć

W IoT tempo wzrostu liczby urządzeń jest zwykle znacznie wyższe niż tempo wzrostu zespołu i budżetu. Kilka pilotowych czujników zmienia się w setki, potem tysiące, a w zastosowaniach masowych – w setki tysięcy punktów pomiarowych. Każdy z nich generuje dane, często w krótkich interwałach: sekundy, milisekundy, czasem ciągły strumień (np. audio czy wideo).

Przy takiej skali pojawiają się twarde ograniczenia:

- pasmo – nie każda sieć udźwignie ciągły streaming surowych danych z tysięcy urządzeń;

- koszty transferu – w szczególności przy łączności komórkowej lub satelitarnej, gdzie płaci się za każdy megabajt;

- opóźnienia – im dalej znajduje się centrum danych chmury i im więcej pośredników w sieci, tym większa latencja;

- stabilność – przerwy w łączności bywają normą, nie wyjątkiem, zwłaszcza w terenie lub w obiektach przemysłowych.

Jeżeli system IoT ma wyłącznie zbierać dane historyczne do późniejszej analizy, opóźnienia rzędu sekund czy minut zwykle nie bolą. Jeśli jednak zadaniem systemu jest natychmiastowe reagowanie na konkretne zdarzenia – np. zatrzymanie linii przy groźnym wzroście wibracji – każda dodatkowa sekunda drogi do chmury i z powrotem staje się realnym ryzykiem.

Gdy decyzja musi zapaść lokalnie i natychmiast

W wielu zastosowaniach IoT decyzje nie mogą czekać na podróż do chmury i z powrotem. Typowe przykłady:

- sterowanie maszyną, która w ułamku sekundy może wyrządzić szkodę ludziom lub sprzętowi,

- systemy bezpieczeństwa – wykrycie niebezpiecznego stężenia gazu, dymu, zbyt wysokiej temperatury,

- pojazdy autonomiczne lub półautonomiczne wymagające reakcji w milisekundach,

- regulacja parametrów procesu technologicznego (ciśnienie, przepływ, temperatura) w czasie zbliżonym do rzeczywistego.

W takich scenariuszach każda warstwa po drodze (router, operator, sieć szkieletowa, bramka chmurowa, serwer aplikacyjny) dodaje swoje milisekundy lub sekundy opóźnienia. Do tego dochodzi ryzyko utraty pakietów, przeciążenia sieci czy awarii regionalnego data center.

Dlatego w systemach o krytycznym czasie reakcji logika sterowania i detekcji musi znajdować się jak najbliżej miejsca powstania danych. Kluczowe decyzje powinny zapadać lokalnie – nawet jeśli pełniejsza analiza i raportowanie odbywają się później w chmurze.

Presja regulacyjna i organizacyjna na lokalne przetwarzanie

Do czynników technicznych dochodzą wymogi prawne i wewnętrzne regulacje organizacji. W wielu branżach:

- dane wrażliwe (zdrowotne, lokalizacja pracowników, materiał wideo z monitoringu) nie mogą być swobodnie przesyłane i przechowywane poza określonym obszarem geograficznym,

- istnieją wymogi, by infrastruktura krytyczna (energetyka, wodociągi, transport, obrona) móc pracować również przy odcięciu od internetu,

- audytorzy wymagają, aby decyzje operacyjne nie zależały wyłącznie od zewnętrznego dostawcy chmury lub łączności publicznej.

W takich warunkach model „wszystko w chmurze” jest trudny do obrony. Organizacje zaczynają wymagać, aby przynajmniej część logiki – w szczególności ta dotycząca sterowania procesem, bezpieczeństwa i ochrony danych – działała na miejscu: w zakładzie, w pojeździe, w budynku. Chmura pozostaje ważna, ale jej rola staje się inna.

Kiedy model cloud-first jest wygodny, a kiedy generuje problemy

Model cloud-first ma swoje mocne strony:

- szybki start i brak konieczności utrzymywania infrastruktury lokalnej,

- łatwy dostęp do zaawansowanych usług (ML, AI, analityka, integracje z SaaS),

- prostsze aktualizacje oprogramowania i zarządzanie konfiguracją urządzeń.

Przy projektach o małej skali, niskiej częstotliwości próbkowania, bez wymagań czasu rzeczywistego, taki model jest bardzo rozsądnym wyborem. Problemy zaczynają się, gdy:

- liczba urządzeń rośnie szybciej, niż planowano,

- koszty transferu i przetwarzania w chmurze zaczynają dominuje w budżecie,

- łączność bywa niestabilna, a system mimo to ma pełnić funkcję krytyczną,

- organizacja zaczyna podlegać ostrzejszym regulacjom bezpieczeństwa i prywatności.

W tym miejscu naturalnie pojawia się koncepcja edge computingu w IoT, która nie odrzuca chmury, lecz zmienia rozkład zadań między brzeg sieci a centralne serwery.

Co to jest edge computing w IoT – definicje, poziomy, kluczowe pojęcia

Prosta definicja edge computingu

Edge computing w IoT to przetwarzanie danych jak najbliżej miejsca ich powstania, zamiast wysyłania wszystkiego do odległego centrum danych. Chodzi o to, aby część logiki – analiza, filtrowanie, wykrywanie zdarzeń, wstępne decyzje – działała na urządzeniach końcowych, bramach lub lokalnych serwerach, a nie wyłącznie w chmurze publicznej.

W praktyce oznacza to, że:

- czujniki lub sterowniki wykonują nie tylko pomiary, ale też elementarną analizę i reagują na proste warunki,

- bramy IoT (gateway) uruchamiają skrypty, modele czy reguły decyzyjne, a do chmury wysyłają jedynie istotne informacje,

- lokalne serwery (edge server, micro data center) integrują dane z wielu urządzeń, zapewniają panel operatorski i pracę mimo braku łączności z internetem.

Chmura w takim podejściu nadal jest ważna, ale zmienia funkcję: staje się warstwą koordynacji, długoterminowego przechowywania danych, trenowania modeli ML, centralnej konfiguracji i zarządzania.

Urządzenie końcowe, brama, serwer brzegowy, chmura – uporządkowanie pojęć

Aby precyzyjnie mówić o architekturze edge w IoT, warto rozróżnić kilka warstw:

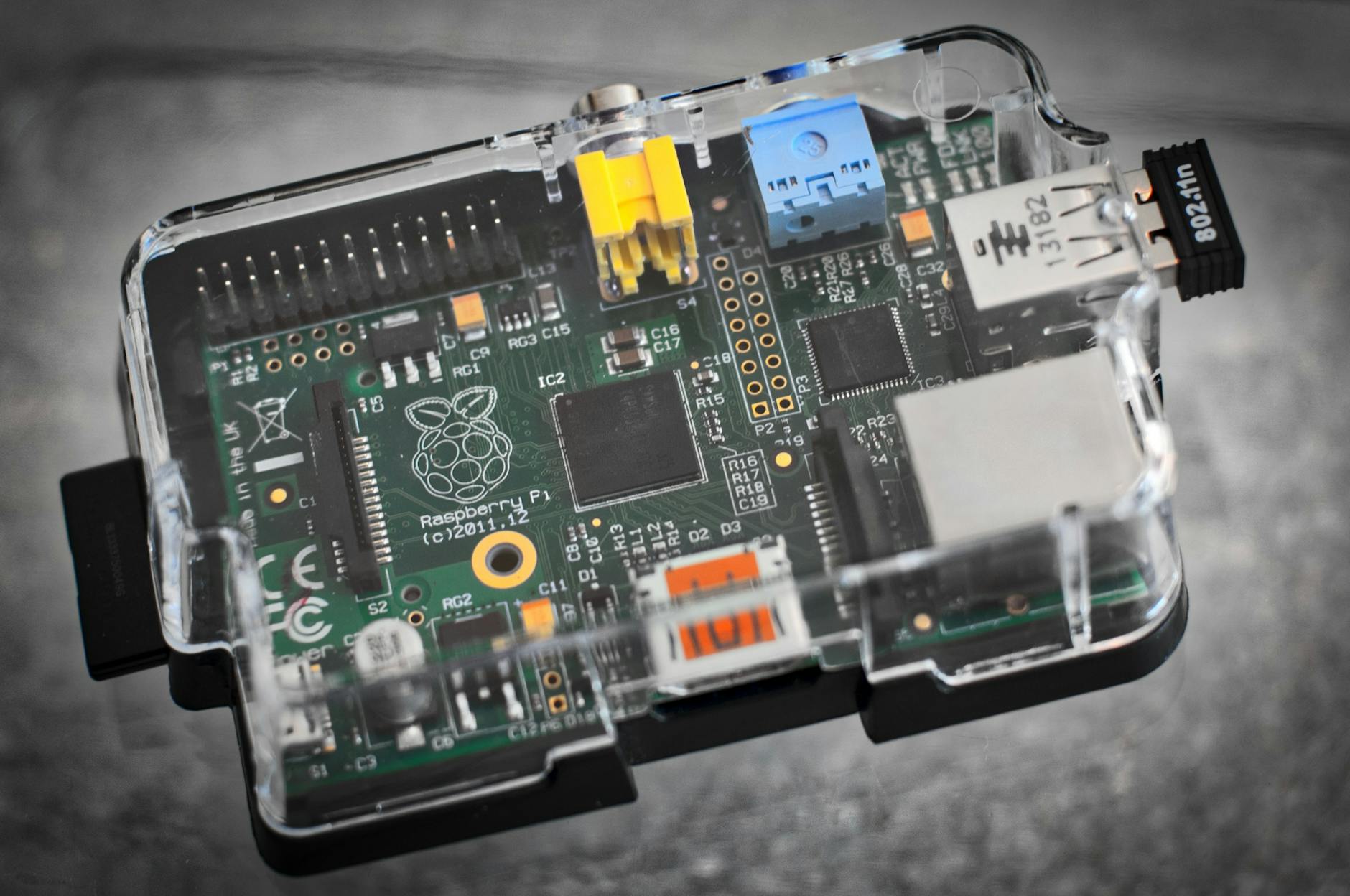

- Urządzenie końcowe (end device) – czujnik, sterownik, licznik, kamera, moduł wykonawczy. Zwykle wyposażony w mikrokontroler (MCU) lub prosty procesor. Może komunikować się bezpośrednio z siecią IP lub przez protokoły niskomocowe (np. Zigbee, BLE) z bramą.

- Brama IoT (gateway) – urządzenie pośredniczące między światem urządzeń końcowych a siecią IP/chmurą. Może agregować dane, wykonywać logikę lokalną, buforować komunikaty, tłumaczyć protokoły (np. z Modbus na MQTT).

- Serwer brzegowy / edge server – mocniejsza maszyna (czasem całe mikrocentrum danych) działająca w lokalizacji użytkownika: w fabryce, magazynie, pojeździe, budynku. Uruchamia kontenery, maszyny wirtualne, lokalne panele WWW, usługi analityczne.

- Chmura centralna – publiczne lub prywatne środowisko cloud (AWS, Azure, GCP, lokalna chmura prywatna), w którym działają usługi globalne: hurtownie danych, długotrwała archiwizacja, trenowanie modeli ML, integracje z systemami biznesowymi.

Te warstwy nie zawsze występują wszystkie naraz. Prosty system może mieć jedynie urządzenia końcowe podłączone bezpośrednio do chmury. Bardziej złożony system przemysłowy będzie miał pełne spektrum: od czujnika na maszynie, przez sterownik PLC, po lokalny klaster serwerów i dopiero na końcu chmurę globalną.

Poziomy „brzegu”: od on-device do mikrocentrum danych

Edge computing w IoT można podzielić na kilka typowych poziomów:

- On-device edge – przetwarzanie na samym urządzeniu końcowym (mikrokontroler, sensor). Przykład: czujnik drgań liczy lokalnie prosty wskaźnik RMS i wysyła tylko wartości zagregowane, zamiast surowego sygnału z akcelerometru.

- Lokalna brama (gateway edge) – przetwarzanie na urządzeniu pośredniczącym. Przykład: brama w hali produkcyjnej zbiera dane z kilkudziesięciu czujników, filtruje je, wylicza lokalne wskaźniki i do chmury wysyła jedynie alarmy oraz uśrednione trendy.

- Micro data center / edge server – niewielkie centrum danych zlokalizowane np. w fabryce, porcie, szpitalu. Może uruchamiać całe stosy aplikacji: lokalny SCADA, bazy danych czasu rzeczywistego, modele ML do wykrywania anomalii, systemy wizualizacji.

Kluczowe jest to, że im bliżej źródła danych znajduje się dana warstwa, tym szybciej może reagować i tym mniej danych musi wysyłać dalej. Architekturę dobiera się według potrzeb: czasem wystarczy minimalna logika on-device, czasem sens ma dopiero lokalny serwer z bardziej zaawansowaną analityką.

Edge, fog, cloud – porządkowanie terminologii

W literaturze pojawiają się także pojęcia fog computing i cloud computing. W uproszczeniu:

- Cloud computing – przetwarzanie w dużych, scentralizowanych centrach danych, zwykle publicznie dostępnych, zlokalizowanych często w innych regionach czy krajach.

- Edge computing – przetwarzanie na skraju sieci, bardzo blisko urządzeń: na nich samych, w bramach lub lokalnych serwerach.

- Fog computing – warstwa pośrednia między edge a chmurą. Zwykle oznacza rozproszone węzły w sieci operatora lub infrastruktury, które pełnią funkcję „mgły” – ani tak lokalne jak edge, ani tak scentralizowane jak chmura.

W praktyce branżowej granice między tymi pojęciami bywają płynne. Z punktu widzenia projektowania IoT najważniejsze jest rozumienie, gdzie dokładnie wykonywana jest dana część logiki i jakie ma to konsekwencje dla opóźnień, niezawodności, bezpieczeństwa i kosztów.

Przesunięcie ciężaru: logika bliżej danych, chmura jako koordynator

Tradycyjny model IoT zakładał: dane do chmury, logika w chmurze. Edge computing przesuwa ciężar na model: logika blisko danych, chmura jako koordynator i magazyn. W praktyce przekłada się to na kilka zmian:

- część reguł decyzyjnych przenosi się do urządzeń i bram: progi alarmowe, lokalne automaty, podstawowe algorytmy ML,

- chmura służy do zarządzania politykami, asynchronicznej analizy, raportowania, retrenowania modeli i dystrybucji nowych wersji logiki,

- dane, które płyną do chmury, są często już wstępnie obrobione: zagregowane, skompresowane, oznaczone metadanymi o wykrytych zdarzeniach.

Taki podział zadań daje dużą elastyczność. System może reagować lokalnie z niskimi opóźnieniami, a jednocześnie wykorzystywać moc obliczeniową chmury do zadań, które nie są krytyczne czasowo, ale wymagają większych zasobów.

Jak działa przepływ danych w architekturze IoT z edge computing

Od czujnika do chmury – ogólny schemat przepływu

Przepływ danych w architekturze IoT z edge computing zwykle przebiega kilkoma etapami:

- Pobranie danych przez czujnik – np. pomiar temperatury, ciśnienia, prądu, drgań, obrazu wideo.

- normalizacja i walidacja – sprawdzenie, czy dane mieszczą się w spodziewanych zakresach, mają komplet metadanych, są zgodne z oczekiwanym formatem,

- filtrowanie i odszumianie – wygładzanie sygnału, eliminacja pojedynczych „pików”, które nie mają znaczenia operacyjnego,

- agregacja – liczenie średnich, wartości minimalnych/maksymalnych, histogramów lub innych statystyk dla określonych przedziałów czasowych,

- wzbogacanie (enrichment) – dodawanie kontekstu: identyfikator linii produkcyjnej, zmiana robocza, numer pojazdu, lokalizacja,

- wykrywanie zdarzeń – stosowanie progów, reguł lub modeli ML w celu zamiany ciągłego strumienia pomiarów na konkretne zdarzenia (alarm, ostrzeżenie, anomalia).

- pętle szybkie – lokalne, zamknięte w obrębie urządzenia lub bramy (np. sterowanie zaworem w zależności od ciśnienia),

- pętle wolne – koordynowane przez chmurę (np. zmiana ogólnych parametrów procesu, plan produkcji, polityka oszczędzania energii).

- przy działającej łączności dane są przesyłane do chmury na bieżąco lub z niewielkim opóźnieniem,

- w przypadku awarii sieci dane są buforowane lokalnie („store”), z zachowaniem kolejności i metadanych czasowych,

- po przywróceniu łączności bufory są stopniowo opróżniane („forward”), aby zsynchronizować stan lokalny z chmurą.

- szyfrowanie od urządzenia do chmury – komunikacja jest zabezpieczona na całej trasie (TLS, DTLS, VPN), niezależnie od tego, czy dane przechodzą przez bramę, czy nie,

- silna tożsamość urządzeń – certyfikaty, TPM, secure elementy; każde urządzenie i brama mają unikalną, kryptograficznie potwierdzoną tożsamość,

- aktualizacje OTA (over-the-air) – możliwość bezpiecznego aktualizowania oprogramowania urządzeń i bram, z weryfikacją podpisu oraz planem wycofania aktualizacji w razie problemów,

- segmentacja sieci – wydzielanie sieci produkcyjnych, technicznych i biurowych, aby ograniczyć skutki potencjalnego incydentu bezpieczeństwa.

- akceptowalne opóźnienie liczy się w setkach milisekund lub mniej,

- reakcja systemu wpływa bezpośrednio na bezpieczeństwo ludzi, maszyn lub infrastruktury,

- proces jest dynamiczny i nie toleruje nieprzewidywalnych opóźnień (jitter),

- obiekt jest mobilny lub odległy (statki, pociągi, kopalnie, tereny wiejskie),

- łączność jest zawodna lub okresowo niedostępna (tunele, strefy przemysłowe o dużych zakłóceniach),

- koszt transmisji danych jest wysoki (sieci satelitarne, roaming, prywatne łącza operatorów).

- mamy setki lub tysiące urządzeń raportujących z wysoką częstotliwością,

- źródła danych produkują strumienie o bardzo dużej objętości (wideo, audio, dane z czujników drgań o wysokim próbkowaniu),

- chcemy przechowywać w chmurze jedynie dane o wartości analitycznej, a nie surowe sygnały.

- danych medycznych,

- danych produkcyjnych uznawanych za tajemnicę przedsiębiorstwa,

- danych infrastruktury krytycznej (energetyka, wodociągi, transport).

- edge przejmuje odpowiedzialność za podstawowe funkcje operacyjne i bezpieczeństwa,

- chmura pełni rolę nadzoru, planowania, raportowania i synchronizacji.

- modele predykcyjne oparte na unikalnym know-how,

- algorytmy optymalizujące procesy produkcyjne,

- rozwiązania związane z bezpieczeństwem fizycznym obiektów.

- liczba urządzeń jest niewielka,

- częstotliwość pomiarów jest niska,

- brak wymagań co do pracy w czasie rzeczywistym,

- przestój systemu w razie problemów z łącznością nie stanowi ryzyka biznesowego czy bezpieczeństwa,

- umieszczenie jak największej części logiki w chmurze przyspiesza eksperymenty,

- system jest prostszy do debugowania i monitorowania,

- łatwiej zebrać dane, na podstawie których podejmie się decyzję, czy edge w ogóle jest potrzebny.

- urządzenia wysyłają stosunkowo mało informacji (np. statusy, zdarzenia, skany kodów),

- analizy i decyzje dotyczą głównie danych z systemów biznesowych,

- opóźnienia rzędu sekund są akceptowalne,

- utrzymania bram, serwerów brzegowych i lokalnych sieci,

- zapewnienia backupów, monitoringu i aktualizacji tych elementów,

- koordynacji działań zespołów IT, OT i dostawców zewnętrznych.

- zbiera dane z wielu linii i maszyn,

- uruchamia modele predykcyjne (np. wykrywanie anomalii drgań),

- lokalnie generuje alarmy i rekomendacje dla służb utrzymania ruchu.

- modele detekcji i klasyfikacji obrazu uruchamia się na kamerach inteligentnych lub serwerach brzegowych,

- do chmury trafiają wyłącznie wyniki (np. „produkt OK/NOK”, „osoba wykryta w strefie”), wybrane klatki lub krótkie klipy dowodowe,

- aktualizacje modeli i ich trening odbywają się w chmurze, ale inference – lokalnie.

- zbiera dane z inwerterów, liczników, zabezpieczeń,

- lokalnie bilansuje obciążenie i steruje magazynami energii,

- utrzymuje pracę wyspy w razie zaniku zasilania z sieci nadrzędnej.

- zbiera dane z CAN, czujników, systemów bezpieczeństwa,

- lokalnie agreguje i filtruje informacje,

- podejmuje decyzje operacyjne – np. alarm dla kierowcy, zmiana parametrów jazdy, awaryjne wyłączenie podsystemu.

- konsolidują dane z latarni, czujników parkowania, kamer, stacji pogodowych,

- lokalnie sterują oświetleniem, sygnalizacją i tablicami informacyjnymi,

- umożliwiają działanie krytycznych funkcji (np. przejścia dla pieszych) niezależnie od stanu łączności z chmurą.

- integrację systemów BMS, kontroli dostępu, CCTV, liczników mediów,

- lokalne reguły sterowania (scenariusze oświetlenia, optymalizacja HVAC w zależności od obecności ludzi),

- możliwość pracy autonomicznej przy braku internetu czy połączenia z centralną dyspozytornią.

- lokalnie analizują sygnały (np. tętno, EKG, saturację),

- wykrywają zdarzenia alarmowe i powiadamiają personel bez pośrednictwa chmury,

- buforują dane medyczne w obrębie szpitala, a do chmury wysyłają jedynie informacje zgodne z regulacjami i polityką prywatności.

- zbierają dane z czujników gleby, stacji pogodowych, maszyn i pojazdów,

- wykonują lokalne obliczenia – np. dawki nawozów, mapy zasobności, trasy przejazdu,

- decydują o działaniu sprzętu w czasie rzeczywistym, a do chmury przekazują jedynie podsumowania i wyniki.

- wielopoziomowe algorytmy decyzyjne (np. korelacja kilku czujników, wykluczanie fałszywych alarmów) umieszcza się na serwerach brzegowych lub centralach lokalnych,

- chmura służy do rejestracji zdarzeń, analiz po incydencie i konfiguracji systemu,

- system pozostaje funkcjonalny przy kompletnym braku połączenia z zewnętrznym światem.

- „tłumacza” protokołów (Modbus, OPC UA, BACnet, CAN, MQTT i inne),

- miejsca realizacji integracji biznesowych, które nie powinny opuszczać sieci lokalnej,

- warstwy abstrakcji, która uniezależnia system od konkretnego sprzętu, bo to edge dostarcza ujednolicony model danych do chmury.

- zapewnić lokalny „punkt koncentracji” urządzeń IoT, POS, systemów CCTV,

- umożliwić zdalne zarządzanie z centrali, łącznie z aktualizacjami i diagnostyką,

- zapewnić podstawowe funkcje operacyjne (płatności offline, podstawowe CCTV, kontrola dostępu) nawet przy braku łączności.

Warstwy obróbki danych na brzegu

Między surowym pomiarem a danymi, które ostatecznie lądują w chmurze lub w systemie biznesowym, pojawia się zwykle kilka warstw przetwarzania. W systemach edge stosuje się najczęściej taki podział:

Część z tych kroków można przenieść bezpośrednio na urządzenia (np. proste progi i agregacje czasowe), a cięższe obliczeniowo etapy zrealizować na bramie lub serwerze brzegowym. Im niżej w łańcuchu zostanie zatrzymana „nieistotna” informacja, tym mniej obciążona będzie chmura.

Lokalna logika sterująca i pętle sprzężenia zwrotnego

Systemy IoT z elementami sterowania wymagają zamkniętych pętli sprzężenia zwrotnego – od pomiaru, przez analizę, do decyzji i działania. W modelu wyłącznie chmurowym cała pętla przechodzi przez internet, co generuje znaczące opóźnienia i ryzyko przerw. Architektura edge rozdziela te pętle:

Dzięki temu urządzenia i bramy mogą bezpośrednio reagować na odczyty (np. odłączyć zasilanie przy wykryciu zwarcia), natomiast chmura analizuje trendy i koryguje strategię w dłuższej perspektywie. Rozdzielenie odpowiedzialności zmniejsza ryzyko błędów wynikających z utraty łączności lub chwilowych opóźnień w sieci.

Buforowanie i praca w trybie „store and forward”

Elementem charakterystycznym dla architektury edge jest świadome zarządzanie okresami braku łączności. Bramy i serwery brzegowe implementują zwykle mechanizm store and forward:

Rozwiązanie to jest istotne zwłaszcza tam, gdzie dane historyczne mają znaczenie auditowe lub regulacyjne (np. farmacja, energetyka), a przerwy w sieci są nieuniknione. W takim scenariuszu local edge zapewnia ciągłość pracy i gromadzenia informacji, a chmura realizuje rolę archiwum oraz centrum raportowania.

Bezpieczeństwo w przepływie danych edge–chmura

Przeniesienie części logiki na brzeg zmienia również sposób myślenia o bezpieczeństwie. Zamiast kilku dobrze chronionych punktów wejścia do chmury pojawia się kilkadziesiąt, kilkaset lub kilka tysięcy węzłów brzegowych. W praktyce architektury edge stosuje się najczęściej kilka uzupełniających się zasad:

Edge nie eliminuje potrzeby centralnego zarządzania bezpieczeństwem. Raczej wymusza połączenie dwóch perspektyw: polityk globalnych (definiowanych w chmurze) z mechanizmami egzekwowanymi lokalnie na poziomie bram, serwerów brzegowych i urządzeń.

Kiedy edge jest lepszy niż chmura – praktyczne kryteria decyzyjne

Wymagania czasowe i deterministyczne opóźnienia

Najbardziej oczywiste kryterium to czas reakcji. Jeżeli:

wówczas logika powinna znajdować się jak najbliżej źródła danych. W takim przypadku przetwarzanie wyłącznie w chmurze jest co do zasady zbyt ryzykowne, nawet jeśli statystycznie sieć działa poprawnie. Typowy przykład to sterowanie ruchem przenośników, robotów lub automatyczne wyłączanie maszyn przy wykryciu nieprawidłowych parametrów.

Ograniczenia łączności: zasięg, przepustowość, koszty

Drugim istotnym kryterium są właściwości łącza pomiędzy obiektem a chmurą. Edge computing ma sens zwłaszcza wtedy, gdy:

Przykładowo w transporcie kolejowym brama pokładowa może lokalnie agregować i analizować dane z czujników w wagonach, a do chmury wysyłać jedynie podsumowania i zdarzenia. Dzięki temu system działa prawidłowo również w tunelach lub obszarach bez zasięgu, a koszty transmisji pozostają pod kontrolą.

Wielkość i częstotliwość danych

Gdy pojedyncze urządzenia generują niewielkie ilości danych, kierowanie wszystkiego do chmury jest wygodne i ekonomiczne. Sytuacja zmienia się, gdy:

W takich przypadkach edge może przeprowadzać kompresję, redukcję, ekstrakcję cech lub wykrywanie zdarzeń, a do chmury przekazywać jedynie wyniki tych operacji. Pozwala to znacząco obniżyć koszty transferu i przechowywania przy jednoczesnym zachowaniu informacji niezbędnej do analiz biznesowych.

Wymogi regulacyjne i jurysdykcyjne dotyczące danych

W niektórych sektorach dane nie mogą opuścić danego kraju, regionu lub nawet budynku bez spełnienia szczególnych warunków. Dotyczy to zwłaszcza:

W takich sytuacjach edge computing umożliwia przetwarzanie wrażliwych informacji na miejscu, a do chmury – jeżeli w ogóle – trafiają tylko dane zanonimizowane, zagregowane lub pozbawione elementów umożliwiających identyfikację. Można w ten sposób łączyć wymogi regulacyjne z korzyściami analityki w chmurze.

Niezależność operacyjna i wymagania ciągłości działania

Tam, gdzie działalność operacyjna nie może się zatrzymać z powodu braku internetu, architektura musi zakładać pracę autonomiczną. Dotyczy to zakładów przemysłowych, magazynów wysokiego składowania, szpitali czy infrastruktury miejskiej. W takich miejscach:

Przykład: system zarządzania budynkiem (BMS) może sterować oświetleniem, HVAC i dostępem do pomieszczeń lokalnie przez serwer brzegowy. Jeżeli łączność z chmurą zniknie, użytkownicy nadal korzystają z budynku, a dane o zdarzeniach są buforowane i zsynchronizowane po przywróceniu połączenia.

Ochrona własności intelektualnej i algorytmów

Niektóre przedsiębiorstwa wolą unikać umieszczania kluczowych algorytmów bezpośrednio w chmurze publicznej, szczególnie gdy chodzi o:

W takich przypadkach część logiki można zrealizować na serwerze brzegowym w sieci wewnętrznej klienta, utrzymując większą kontrolę nad kodem, danymi treningowymi i procesem aktualizacji. Chmura służy wtedy głównie do przechowywania mniej wrażliwych danych i skalowania zasobów na potrzeby testów, symulacji lub treningu nowych modeli.

Kiedy pozostanie przy klasycznej chmurze ma większy sens

Proste systemy o niewielkiej skali i braku wymagań czasu rzeczywistego

Nie każde rozwiązanie IoT wymaga od razu rozbudowanej architektury edge. Jeżeli:

to prosty model cloud-first zwykle w zupełności wystarcza. Dobrym przykładem są proste systemy monitoringu środowiskowego, odczyty wodomierzy czy małe instalacje fotowoltaiczne, gdzie opóźnienia rzędu minut nie mają praktycznego znaczenia.

Gdy celem jest szybkie MVP i weryfikacja koncepcji

Na etapie budowania prototypu lub MVP rozproszone architektury edge potrafią utrudniać iteracje. Każda zmiana logiki wymaga aktualizacji urządzeń i bram, testów w terenie, synchronizacji wersji. W takich warunkach:

Praktycznym podejściem jest rozpoczęcie od wariantu cloud-first z minimalną logiką na urządzeniach, a dopiero po potwierdzeniu skali i wymagań czasu rzeczywistego – stopniowe przenoszenie części funkcji na brzeg.

Gdy dane są naturalnie „chmurowe” i nie generują dużych wolumenów

W niektórych projektach źródła danych są już w chmurze (np. aplikacje SaaS, systemy ERP, integracje API), a urządzenia IoT stanowią jedynie dodatkowe wejście do istniejącego ekosystemu. Jeżeli:

to rozbudowany edge bywa przerostem formy nad treścią. W takim układzie zdecydowana większość wartości powstaje z integracji danych w chmurze, a logika na brzegu ogranicza się do podstawowych funkcji (np. lokalne cache, prosta obsługa offline).

Gdy organizacja nie ma zasobów do utrzymania infrastruktury lokalnej

Architektura edge przenosi część złożoności z chmury do świata fizycznego. Pojawia się konieczność:

Jeżeli organizacja nie dysponuje zespołem lub partnerem zdolnym do podjęcia takiej odpowiedzialności, a projekt nie ma charakteru krytycznego, prostsza architektura cloud-first może okazać się rozsądniejsza. W takiej sytuacji lepiej skupić się na dobrym zaprojektowaniu bezpieczeństwa i zarządzania danymi w chmurze, niż budować lokalną infrastrukturę bez odpowiednich kompetencji.

Typowe scenariusze i przykłady użycia edge computingu w IoT

Przemysł 4.0 i predykcyjne utrzymanie ruchu

W zakładach produkcyjnych edge computing zwykle pojawia się jako naturalne przedłużenie istniejącej automatyki (PLC, SCADA, DCS). Edge nie zastępuje sterowników, ale:

Przykładowo na prasie czy linii pakującej montuje się czujniki drgań i temperatury, a serwer brzegowy w szafie sterowniczej oblicza wskaźniki stanu łożysk. Do chmury trafiają jedynie wskaźniki zdrowia i incydenty, a nie surowe sygnały z wysokim próbkowaniem. Pozwala to reagować z wyprzedzeniem, bez przeciążania łącza i bez ryzyka opóźnień w diagnostyce.

Wizja maszynowa i analiza obrazu

Systemy wizyjne generują strumienie danych, które trudno i drogo przesyłać w całości do chmury. Dlatego w praktyce:

Taki wzorzec dobrze sprawdza się zarówno na liniach kontroli jakości, jak i w systemach bezpieczeństwa obiektów (np. wykrywanie wtargnięcia na teren składowiska czy do strefy niebezpiecznej przy robocie).

Energetyka, mikrosieci i OZE

W energetyce rozproszonej (farmy fotowoltaiczne, wiatrowe, mikrosieci) edge computing pełni rolę lokalnego „koordynatora”:

Chmura jest używana do raportowania, prognozowania produkcji czy optymalizacji kontraktów. Sama decyzja, czy w danej sekundzie ograniczyć moc, przełączyć źródło lub odłączyć odbiornik, zapada jednak na brzegu, bo zależy od bieżących parametrów sieci i musi być podjęta praktycznie natychmiast.

Transport, logistyka i floty pojazdów

W transporcie edge często ma postać jednostki pokładowej (gateway w pojeździe, kontenerze, wagonie). Taka jednostka:

Do chmury wysyłane są raporty, zdarzenia i dane historyczne potrzebne do planowania tras, serwisu czy analiz kosztowych. Przy braku zasięgu jednostka działa autonomicznie, buforuje dane i synchronizuje je po odzyskaniu łączności. W przypadku wagonów chłodniczych edge pilnuje temperatury i wilgotności, a chmura zajmuje się długoterminową analizą jakości łańcucha dostaw.

Miasta inteligentne i infrastruktura komunalna

W rozwiązaniach smart city komunikacja z chmurą bywa ograniczona przez dużą liczbę punktów i rozproszoną infrastrukturę. Lokalne węzły edge montowane w szafach ulicznych lub stacjach bazowych:

Na poziomie miejskim chmura pozostaje miejscem integracji międzyresortowej (transport, energetyka, bezpieczeństwo), ale logika „pierwszej reakcji” – np. przy lokalnych podtopieniach czy awarii zasilania – zwykle opiera się na serwerach brzegowych.

Budynki komercyjne i kampusy

W dużych biurowcach, centrach handlowych czy kampusach uczelnianych serwer brzegowy często łączy funkcje automatyki budynkowej, bezpieczeństwa i zarządzania zużyciem mediów. Typowa konfiguracja obejmuje:

Chmura służy głównie właścicielowi portfela nieruchomości do porównań między obiektami, analizy efektywności energetycznej i raportowania ESG. Samo sterowanie w skali sekund pozostaje bliżej urządzeń, żeby uniknąć opóźnień i zależności od łącza WAN.

Zdrowie, opieka i medtech

W ochronie zdrowia edge computing pomaga łączyć wymogi regulacyjne z potrzebą automatyzacji. Urządzenia przyłóżkowe, aparaty diagnostyczne czy systemy monitorowania pacjentów:

Przy urządzeniach wearables stosuje się często model mieszany: smartfon lub domowy hub pełni rolę mini-edge, który dokonuje wstępnej analizy i kompresji, a chmura jest wykorzystywana do długoterminowych analiz oraz telekonsultacji.

Rolnictwo precyzyjne i zastosowania terenowe

Na rozległych terenach rolniczych, w lasach czy w górnictwie odkrywkowym łączność z chmurą bywa ograniczona lub kosztowna. Lokalne węzły edge (np. na maszynach rolniczych, dronach, masztach) zwykle:

Dzięki temu kombajn czy opryskiwacz nie musi „czekać” na odpowiedź serwera w centrum danych, żeby zmienić dawkę nawozu na kilkumetrowym fragmencie pola. Synchronizacja z chmurą następuje po powrocie do zasięgu lub na koniec dnia.

Bezpieczeństwo fizyczne i systemy krytyczne

Systemy alarmowe, syreny ostrzegawcze, monitoring pożarowy czy detekcja gazów wybuchowych działają w reżimie, w którym opóźnienie i zawodność łącza są nieakceptowalne. Z tego powodu:

W obiektach o szczególnym znaczeniu (rafinerie, terminale LNG, obiekty wojskowe) edge bywa jedynym miejscem wykonywania algorytmów sterowania, a chmura pełni jedynie pomocniczą rolę analityczną lub w ogóle nie jest dopuszczona.

Edge jako platforma do lokalnych integracji

Wiele projektów IoT wymaga połączenia urządzeń i systemów od różnych dostawców, często z różnymi protokołami i cyklami życia. Serwer brzegowy może wtedy pełnić rolę:

Taki wzorzec zmniejsza ryzyko „uwiązania” do jednego producenta i ułatwia stopniową modernizację instalacji – najpierw dokłada się serwer brzegowy, a dopiero z czasem wymienia urządzenia końcowe.

Rozproszone środowiska z ograniczonym personelem IT

W sieciach sklepów, stacjach paliw, małych magazynach czy małych zakładach produkcyjnych rzadko jest obecny na miejscu dedykowany zespół IT. Edge computing przy odpowiednim zaprojektowaniu może:

Taka architektura łączy model cloud-first z praktycznymi wymaganiami ciągłości działania w małych lokalizacjach. Serwer brzegowy jest zarządzany centralnie, ale działa lokalnie, co z perspektywy obsługi na miejscu sprowadza się zwykle do prostych czynności serwisowych.